De AI Act in detail

In onze vorige blog, “Wat is de AI Act?”, onderzochten we de definitie van AI volgens de AI Act, hoe systemen kunnen worden ingedeeld in drie verschillende risicocategorieën: onaanvaardbaar-, hoog- en beperkt risico en de gevolgen daarvan. Deze blog gaat dieper in op de AI Act en onderzoekt de positie van de wet in de context van wereldwijde AI-regelgeving, de lopende discussies en de belangrijkste data in verband met de AI Act.

Wereldwijde Inspanningen voor AI Wetgeving

De EU is niet de enige wetgever die AI probeert te reguleren en verschillende landen hanteren verschillende benaderingen en reguleringsniveaus. Neem Japan als voorbeeld; hun wetgevende inspanningen op het gebied van AI zijn relatief beperkt geweest, zeker als je bedenkt dat ze pioniers waren op het gebied van de ontwikkeling van AI. In Japan is het belangrijkste initiatief om AI te reguleren de “Social Principles of Human-Centric AI”, waarin de nadruk ligt op ethische overwegingen maar waarin concrete regelgevende maatregelen ontbreken om AI toepassingen te reguleren.

De Verenigde Staten zijn proactiever geweest bij het invoeren van AI wetgeving. De “AI Bill of Rights” richt zich op het waarborgen van individuele rechten in de context van AI-technologieën. Daarnaast is er de “Algorithmic Accountability Act” en de “Data Protection & Privacy Act”, beide voorgesteld om de uitdagingen op het gebied van verantwoording, transparantie en gegevensprivacy bij AI toepassingen aan te pakken. Nog recenter heeft de president van de Verenigde Staten, Joe Biden, een uitvoerend bevel getekend om nieuwe normen op te stellen voor AI-veiligheid en -privacy.

In tegenstelling tot de Verenigde Staten is China een andere weg ingeslagen. Hun inspanningen op het gebied van wetgeving zijn erop gericht om ervoor te zorgen dat AI-toepassingen, zoals hun eigen ChatGPT-variant, geen gevoelige informatie, met name over de Oeigoeren, delen met hun gebruikers.

Brazilië staat nog aan het begin van zijn AI-regulering. De Braziliaanse aanpak kan lijken op “copy paste” van het regelgevingskader van de EU. Dit kan betekenen dat er vergelijkbare principes, richtlijnen en beleidslijnen worden aangenomen om een verantwoord en ethisch gebruik van AI binnen de Braziliaanse context te waarborgen.

Op dit moment wordt verwacht dat de AI Act van de Europese Unie de meest verstrekkende wetgevende inspanning zal zijn, wat betekent dat als een bedrijf voldoet aan de AI Act, het automatisch voldoet aan alle andere regelgeving over de hele wereld.

Hoe zit het met de lopende discussies?

Er is nog enige discussie over hoe ‘foundation modellen’, zoals ChatGPT, precies moeten worden opgenomen in de AI Act. In sommige gevallen vereist de AI Act documentatie over het exacte doel van het AI Act. Bepaalde modellen, waaronder ChatGPT, hebben echter geen exact doel, behalve dat ze ontworpen zijn om een breed scala aan taken uit te voeren. Hoe de wetgevers met dit probleem zullen omgaan, moet nog worden besloten. Wat de zaak nog ingewikkelder maakt, is dat nog niet is besloten wat precies een foundation model is. Parameters, rekenkracht en data sources zijn allemaal mogelijke criteria om te bepalen wat een foundation model is, maar een definitieve beslissing moet nog worden genomen.

Een andere dicussie draait om de positie van biometrische herkenningssystemen. De discussie richt zich op een gevoelig evenwicht tussen het potentieel van het verbeteren van de veiligheid en de aanzienlijke gevolgen voor de privacy die deze systemen met zich meebrengen. Deze discussie is al aan de gang sinds het eerste ontwerp van de AI Act.

Aan de ene kant hebben biometrische herkenningssystemen, zoals gezichtsherkenningstechnologie, bewezen krachtige hulpmiddelen te zijn voor wetshandhavings- en veiligheidsdiensten. Deze systemen kunnen helpen om criminelen te identificeren en op te sporen, vermiste personen op te sporen en terroristische aanvallen te voorkomen. De mogelijkheid om gezichten of andere biometrische gegevens te vergelijken met databases kan leiden tot de aanhouding van gevaarlijke individuen, wat leidt tot een veiligere samenleving.

Aan de andere kant roept het grootschalige gebruik van biometrische herkenningssystemen aanzienlijke zorgen op over de privacy. Deze systemen zijn in staat om gevoelige persoonlijke gegevens te verzamelen en te verwerken zonder medeweten of toestemming van personen. De constante surveillance en het potentieel voor misbruik roepen vragen op over de aantasting van privacy en burgerlijke vrijheden. Voorstanders van privacy stellen dat onbeperkt gebruik van biometrische herkenning kan leiden tot massasurveillance, beperking van de vrijheid van meningsuiting en machtsmisbruik door overheden en bedrijven.

Belangrijke Data

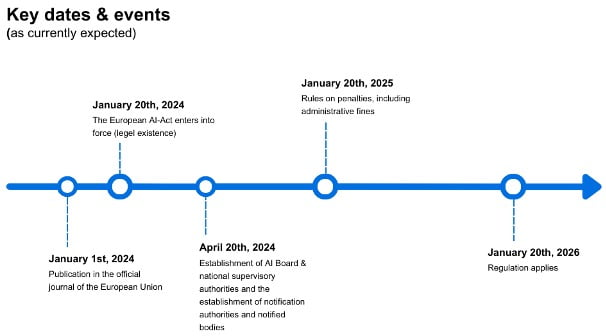

Wat deze discussies nog extra versterkt, is de naderende deadline van 1 januari 2024, die een gevoel van urgentie aan de discussies toevoegt. De deadline van 1 januari is een zelfopgelegde deadline. Op deze datum verschijnt het Publicatieblad van de Europese Unie, dat slechts twee keer per jaar verschijnt. Alle nieuwe wetgeving worden in dit tijdschrift gepubliceerd. Het missen van deze deadline zou resulteren in een aanzienlijke vertraging van een half jaar bij het aannemen van deze wetgeving, iets wat de wetgever zal proberen te voorkomen. Andere belangrijke data worden beschreven in Artikel 85 van de AI Act. Als de deadline van 1 januari wordt gehaald, ziet het tijdschema er als volgt uit:

Laatste Opmerkingen

Onze analyse bood een kijkje in de globale wetgevingscontext waarin de AI Act wordt ontwikkeld en de lopende discussies. Clever Republic doet er alles aan om op de hoogte te blijven van de nieuwste ontwikkelingen in dit regelgevingslandschap. We zullen de ontwikkelingen in de discussies op de voet blijven volgen en jullie tijdig van updates voorzien!

Wil je meer weten over de AI Act of heb je hulp nodig bij AI Governance? Aarzel niet om contact op te nemen via e-mail of het contactformulier op onze website!